Hoy anunciamos dos nuevas tecnologías para combatir la desinformación, un nuevo trabajo para ayudar a educar al público sobre el problema, y asociaciones para ayudar a avanzar rápidamente en estas tecnologías y esfuerzos educativos.

La desinformación está a la orden del día, y en constante aumento, y se nos puede presentar de diferentes maneras, por lo que desde Microsoft acaban de presentar dos nuevas tecnologías para hacer frente a la desinformación en dos de los múltiples frentes posibles.

Por un lado han presentado Microsoft Video Authenticator, una herramienta que irá analizando fotos y videos y ofrecerá un nivel de puntuación o un nivel de probabilidad de que estos medios hayan sido manipulados artificialmente mediante la inteligencia artificial, y por el otro, una tecnología capaz de detectar contenido manipulado y garantizar cuando es un contenido auténtico.

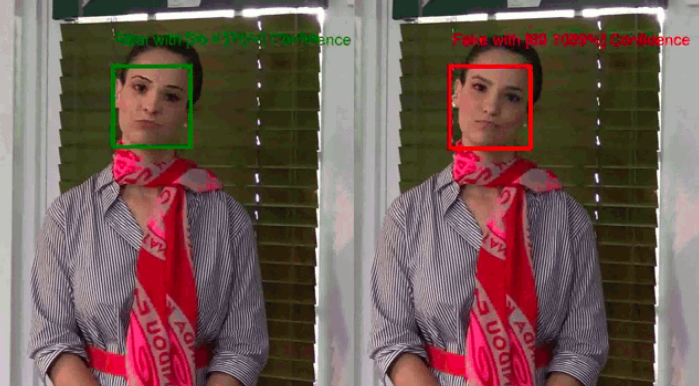

Microsoft Video Authenticator analizará una foto fija, aunque también analizará en tiempo real cada fotograma de un video para ofrecer el porcentaje de probabilidad o puntuación de confianza de que los medios han sido manipulados mediante el uso de la Inteligencia Artificial para conseguir un acabado que a simple vista sea bastante realista.

A este respecto, Microsoft señala que «funciona detectando el límite de fusión de los elementos deepfake y sutil desvanecimiento o escala de grises que pueden no ser detectables por el ojo humano». Se trata de una tecnología desarrollada originalmente por Microsoft Research junto con el equipo de IA de Microsoft y el Comité de IA, Ética y Efectos en Ingeniería e Investigación (AETHER) de Microsoft.

Acorde a la compañía:

Video Authenticator se creó utilizando un conjunto de datos públicos de Face Forensic ++ y se probó en el conjunto de datos de desafío de detección de DeepFake, ambos modelos líderes para entrenar y probar tecnologías de detección de deepfake.

Y la nueva tecnología de detección de contenido manipulado, la misma consta de dos partes. Por un lado, una herramienta integrada en Microsoft Azure que permita al productor del contenido la agregación de hashs y certificados a sus contenidos, y por el otro lado, un lector, que bien podría ser una extensión de navegador u otras formas, capaz de verificar los certificados y tratar de hacer coincidir los hashs, ofreciendo la garantía de autenticidad de los contenidos a los usuarios, además de poder conocer quienes los han producido.

Esta tecnología ha sido desarrollada por Microsoft Research y Microsoft Azure en asociación con el Programa Defending Democracy, y formará parte de una reciente iniciativa de la BBC llamada Project Origin.